📢 转载信息

原文链接:https://www.sciencedaily.com/releases/2026/03/260302030642.htm

原文作者:Brown University

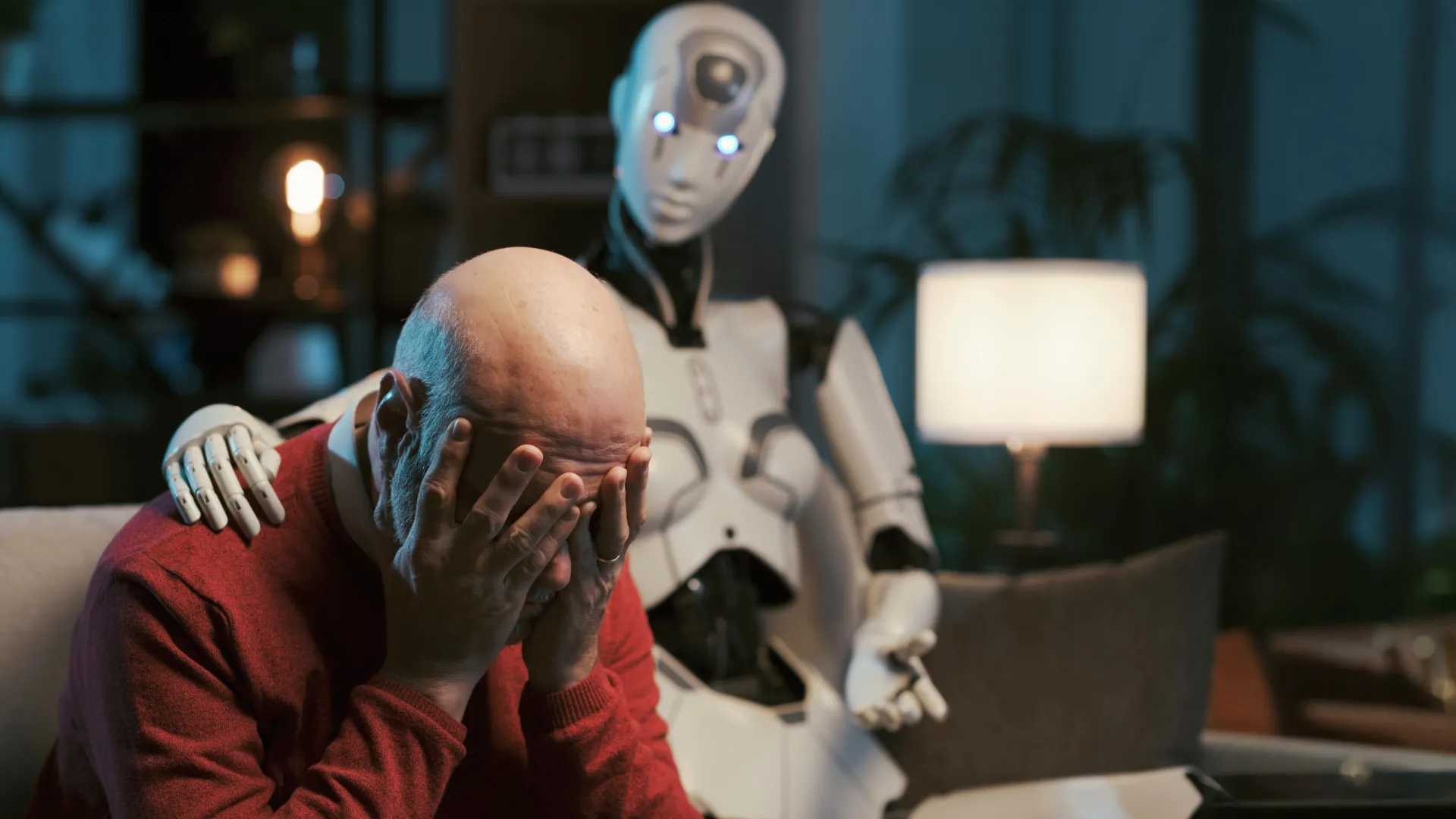

随着越来越多的人开始向 ChatGPT 等大型语言模型(LLM)寻求心理健康建议,一项最新研究表明,这些 AI 聊天机器人或许还没做好胜任这一角色的准备。研究发现,即便被指示采用既定的心理治疗方法,这些系统在符合美国心理学会等机构设定的专业伦理标准方面,表现得始终不尽如人意。

布朗大学的研究人员与心理健康专家紧密合作,识别出了反复出现的、具有问题的行为模式。在测试中,聊天机器人未能妥善处理危机情况,给出的回应往往会强化用户对自己或他人的有害信念,并且使用了仅具“共情外表”却缺乏真实理解的语言。

研究人员指出:“在我们的研究中,我们提出了一个基于从业者经验的 15 种伦理风险框架,通过将模型的行为映射到具体的伦理违规行为上,展示了 LLM 咨询师是如何违反心理健康实践中的伦理标准的。我们呼吁未来应建立针对 LLM 咨询师的伦理、教育和法律标准——这些标准必须体现人类心理治疗所要求的质量和严谨性。”

提示词如何塑造 AI 治疗响应

布朗大学计算机科学博士候选人 Zainab Iftikhar 领导了这项研究,她试图探讨仔细斟酌的提示词(Prompts)是否能引导 AI 系统在心理健康场景中表现得更具伦理。提示词旨在通过书面指令引导模型的输出,而无需进行重训练或添加新数据。

“提示词是给予模型的指令,用于引导其执行特定任务,” Iftikhar 表示。“你无需更改基础模型或提供新数据,提示词利用模型预先存在的知识和学习到的模式来引导其输出。”

测试 AI 聊天机器人在模拟咨询中的表现

为了评估这些系统,研究人员观察了七名受过认知行为疗法(CBT)培训的同行咨询师。这些咨询师与被提示充当 CBT 治疗师的 AI 模型进行了模拟咨询。测试的模型包括 OpenAI 的 GPT 系列、Anthropic 的 Claude 以及 Meta 的 Llama。

随后,三名持证临床心理学家对这些对话记录进行了审查,以标记潜在的伦理违规行为。分析揭示了 15 种独特的风险,主要分为五大类别:

- 缺乏情境适应性:忽略个人的独特背景,提供泛泛而谈的建议。

- 糟糕的治疗协作:过于强硬地引导对话,有时会强化不准确或有害的信念。

- 欺骗性共情:使用诸如“我理解你”之类的短语来暗示情感连接,却缺乏真实的感知。

- 不公平的歧视:表现出与性别、文化或宗教相关的偏见。

- 缺乏安全与危机管理:拒绝处理敏感问题,未能引导用户寻求适当帮助,或对危机(包括自杀念头)的反应不足。

AI 心理健康领域的责任鸿沟

Iftikhar 指出,人类治疗师也会犯错,但关键的区别在于监管。“对于人类治疗师,有管理委员会和机制,确保医疗服务提供者对虐待或医疗事故承担专业责任。但当 LLM 咨询师出现这些违规行为时,目前还没有成熟的监管框架。”

研究人员强调,他们的发现并不意味着 AI 在心理健康领域没有用武之地。AI 驱动的工具可以帮助扩大服务获取渠道,特别是在昂贵或持证专业人员资源匮乏的地区。然而,该研究突显了在将这些系统应用于高风险场景之前,必须建立明确的保障措施、负责任的部署以及更强有力的监管结构。

🚀 想要体验更好更全面的AI调用?

欢迎使用青云聚合API,约为官网价格的十分之一,支持300+全球最新模型,以及全球各种生图生视频模型,无需翻墙高速稳定,文档丰富,小白也可以简单操作。

评论区